五角大楼540亿美元签约AI巨头,民用AI正式进入军事决策链

创始人

2026-05-12 10:13:44

0次

2026年5月,AI军事化应用迎来历史性突破。五角大楼正式签约7家AI巨头,接入最高机密IL-6/IL-7网络,预算高达540亿美元,用于AI作战系统、情报决策、目标生成、无人集群控制。民用AI正式从"辅助参谋"变为战争决策节点,军备竞赛进入"算法主导"新阶段。

签约方包括OpenAI、Google、NVIDIA、Microsoft、Amazon、SpaceX、Reflection AI。军方AI平台GenAI.mil上线5个月已有130万+国防部人员使用,部署数十万个智能体,部分任务周期从"数月"压缩至"数天"。这一变革标志着AI技术从商业应用延伸至国防安全领域,对全球地缘政治格局产生深远影响。

值得关注的是,Anthropic因拒绝开放模型用于完全自主武器与大规模监控,3月被五角大楼列为"供应链风险",禁止合作并涉诉讼。这一事件引发了业界对AI伦理边界的深刻讨论:技术进步究竟应该服务于什么目标?企业在国家安全与人类福祉之间如何平衡?

与此同时,欧盟《AI法案》于5月3日正式生效,成为全球首部全面性AI监管框架。该法案按风险分级监管:社会评分、实时生物识别、操纵性AI被全面禁止;医疗、教育、司法、关键基础设施等高风险领域强制合规、人类监督;通用大模型需透明度报告、安全评估、版权溯源。

AI治理从"建议"走向"强制",全球AI产业进入规范化发展新阶段。技术在前进,规则在完善,人类正在探索一条既能释放AI潜力又能管控风险的中间道路。

2026年5月,AI军事化应用迎来历史性突破。五角大楼正式签约7家AI巨头,接入最高机密IL-6/IL-7网络,预算高达540亿美元,用于AI作战系统、情报决策、目标生成、无人集群控制。民用AI正式从"辅助参谋"变为战争决策节点,军备竞赛进入"算法主导"新阶段。

签约方包括OpenAI、Google、NVIDIA、Microsoft、Amazon、SpaceX、Reflection AI。军方AI平台GenAI.mil上线5个月已有130万+国防部人员使用,部署数十万个智能体,部分任务周期从"数月"压缩至"数天"。这一变革标志着AI技术从商业应用延伸至国防安全领域,对全球地缘政治格局产生深远影响。

值得关注的是,Anthropic因拒绝开放模型用于完全自主武器与大规模监控,3月被五角大楼列为"供应链风险",禁止合作并涉诉讼。这一事件引发了业界对AI伦理边界的深刻讨论:技术进步究竟应该服务于什么目标?企业在国家安全与人类福祉之间如何平衡?

与此同时,欧盟《AI法案》于5月3日正式生效,成为全球首部全面性AI监管框架。该法案按风险分级监管:社会评分、实时生物识别、操纵性AI被全面禁止;医疗、教育、司法、关键基础设施等高风险领域强制合规、人类监督;通用大模型需透明度报告、安全评估、版权溯源。

AI治理从"建议"走向"强制",全球AI产业进入规范化发展新阶段。技术在前进,规则在完善,人类正在探索一条既能释放AI潜力又能管控风险的中间道路。

相关内容

热门资讯

AI资本狂飙:DeepSeek...

2026年5月,AI行业迎来资本狂飙期,多家头部公司刷新融资纪录。DeepSeek寻求首轮融资规模最...

五角大楼540亿美元签约AI巨...

2026年5月,AI军事化应用迎来历史性突破。五角大楼正式签约7家AI巨头,接入最高机密IL-6/I...

AI编程革命:Claude C...

2026年,AI编程工具彻底改写了软件开发模式,手写代码时代正式落幕。Claude Code Aut...

国产大模型周调用量暴涨81.7...

2026年5月,中国AI大模型市场迎来历史性时刻。根据OpenRouter最新测算数据,4月27日至...

GPT-5.5全量推送:幻觉率...

2026年5月,OpenAI正式发布GPT-5.5系列模型,标志着AI大模型从"能用"正式迈入"好用...

AI大模型诸神之战:DeepS...

2026年5月的第一周,中国AI大模型行业的融资节奏堪称"疯狂"。DeepSeek、月之暗面、阶跃星...

数据成为AI竞争新焦点:高质量...

数据,正在成为AI大模型竞争的新焦点。当模型架构趋于同质化、算力成为基础设施后,高质量数据的获取与生...

AI Agent硬件爆发:耳机...

2026年,AI Agent正从软件概念走向硬件实体,一场以"智能体+可穿戴"为核心的产品革命正在悄...

从会做事到懂人心,具身智能迎来...

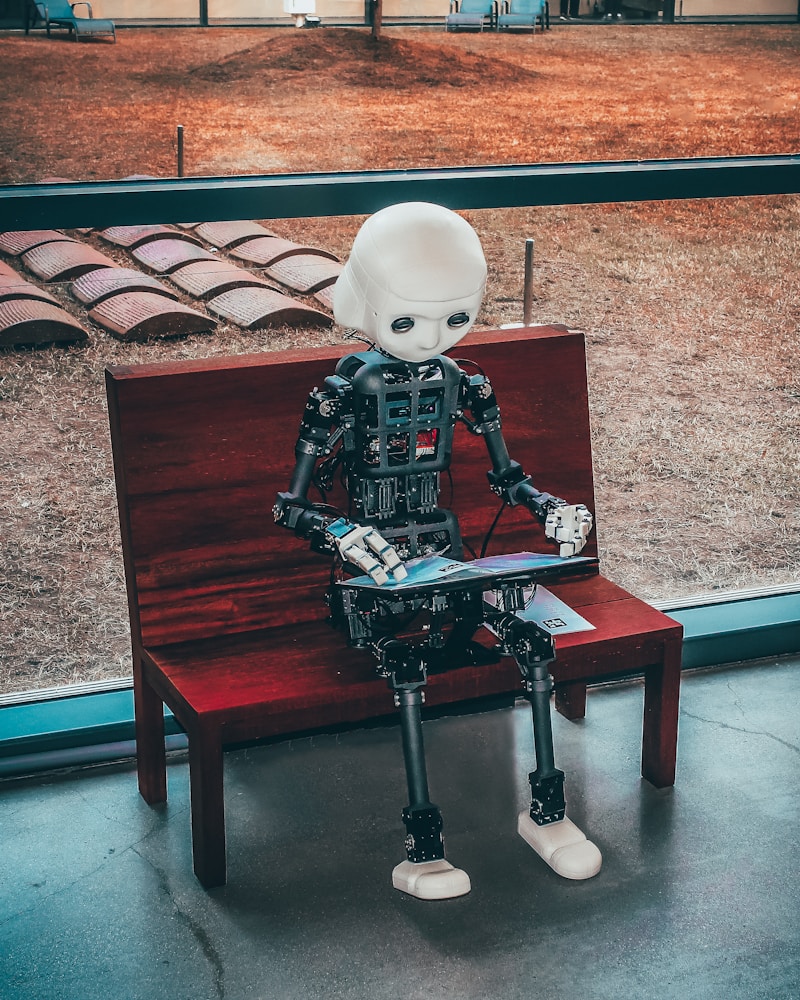

具身智能正在经历从"会做事"到"懂人心"的关键跃迁。2026年5月,多项突破性进展表明,这一领域正从...

DeepSeek首轮融资500...

2026年5月,中国AI大模型领域的融资热度再次刷新纪录。DeepSeek、月之暗面、阶跃星辰三家公...